自己的 AI 自己養:

Gemma 4 全版本解析與 Ollama 超圖解部署教學

不想每個月付訂閱費?擔心公司機密上傳雲端會外洩?其實你可以把超聰明的 AI 直接「下載」到自己的電腦裡。這篇帶你一次看懂 Gemma 4 各版本的差異,並手把手教你無痛安裝,連阿嬤都能學會!

Executive Summary: 核心亮點摘要 (TL;DR)

- 什麼是 Gemma 4? Google 最新推出的開源 AI 模型系列,主打輕量級但在各項測試指標都擁有越級打怪的實力,非常適合個人電腦運行。

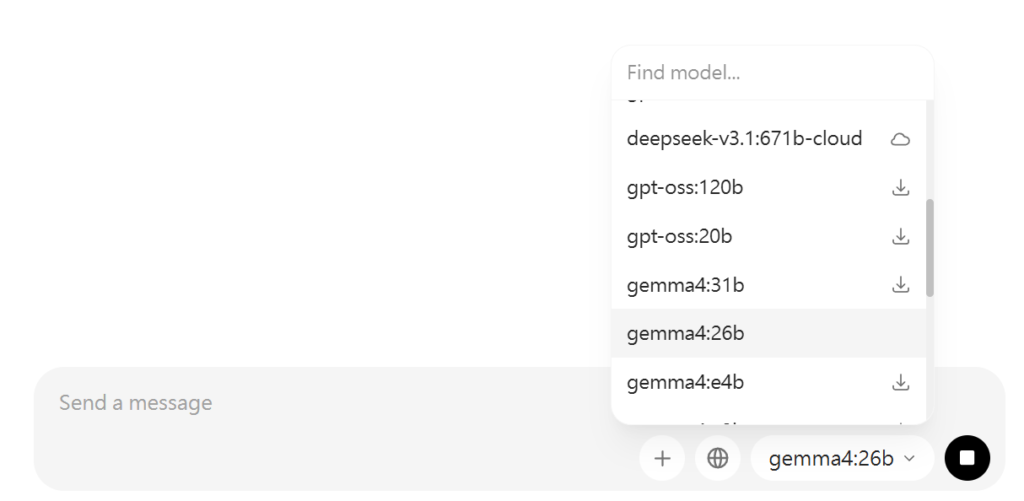

- 各版本怎麼選? E2B / E4B 適合一般文書筆電(8GB RAM即可);26B 是效能與硬體的最佳平衡點;31B 則是無閹割的滿血巨獸,適合專業高階顯卡玩家。

- Ollama 三步部署法: 下載安裝檔 ➔ 終端機輸入一行指令 `ollama run gemma4` ➔ 自動下載並開啟對話,全程不用寫半行 Code。

- 實測血淚心得: 寫 Code 能力還可以,但「一次只能吐出一個檔案」,需要學習如何一步步引導 AI 給出完整專案,文中會分享我的破解心法。

01. Gemma 4 到底是什麼?為什麼大家都在瘋本地部署?

你可能聽過 Gemini(Google 家的付費 AI),但你可能對 Gemma 比較陌生。簡單來說,Gemma 就是 Gemini 的「親生弟弟」,一個開源(Open Source)、免費開放給大家下載使用的版本。而到了 Gemma 4,這個模型進化到了另一個境界,它的參數學習效率更高,這意味著它不需要像雲端機房那種怪獸級的電腦,一般人的筆記型電腦也能把它喚醒。

為什麼我們不繼續用好好的網頁版 ChatGPT 就好,要花時間把它裝在自己電腦裡呢?其實原因有三個:

- 絕對的隱私安全: 當你把公司的營收報表或是病患資料丟給雲端 AI 時,這些資料其實已經離開了你的電腦。但在本地端跑 Gemma 4,就算你把網路線拔掉它一樣能工作,資料 100% 留在你的硬碟裡。

- 客製化潛力無窮: 雲端 AI 都有「審查」,它就不斷跟你說「對不起我無法協助」。

- 完全免費: 沒有 API 呼叫次數限制,沒有每個月的 20 美金。只要你家電費繳得起,你要它算到天荒地老都可以。

02. 家族大解密:E2B, E4B, 26B, 31B 到底差在哪?

剛接觸開源模型的人,一定會被模型後面那一串數字跟英文字母搞瘋。其實很簡單,字母 B 代表的是 Billion(十億參數)。你可以把它想像成這個 AI 腦袋裡的「神經元數量」。參數越大,懂的東西越多、邏輯越好,但也越吃你電腦的記憶體(RAM)。這次 Gemma 4 帶來了四個主要版本,我們用選車的概念來比喻:

1. E2B (Efficient 2 Billion):輕巧靈活的代步小車

這個版本只有 20 億參數,超級輕量。E 代表 Efficient(高效能優化版)。它的強項在於「快」,打字速度可能比你閱讀還快。雖然沒辦法處理太複雜的邏輯推理,但拿來做簡單的信件潤飾、文章摘要,或是基礎的翻譯,已經非常夠用了。一般的輕薄文書筆電就能順跑。

2. E4B (Efficient 4 Billion):高 CP 值的家庭房車

40 億參數的版本,是我認為最適合一般大眾日常使用的甜密點。它的邏輯能力比 E2B 好上一大截,能夠理解稍微複雜的語境,幫忙寫一些簡單的 Python 或網頁程式碼也不在話下。如果你只是想嘗鮮,我強烈建議從 E4B 開始下載。

3. 26B(26 Billion):改裝過的高性能跑車

這個名字看起來最複雜,讓我來拆解一下。原本 26B (260 億參數) 是一個極度龐大的模型,一般人的電腦根本裝不下。雖然損失了一點點精度,但保留了 26B 絕大部分的超強推理與寫程式能力,是一般高階電競筆電或 Mac 能夠跑得動的「最強 CP 值」選擇。

4. 31B (31 Billion):無閹割的頂級超跑

310 億參數的滿血怪獸。沒有經過任何閹割與壓縮,擁有最完整的知識庫和極度細膩的語言理解能力。但代價是,它會榨乾你電腦所有的資源。除非你是專業的 AI 研究員,或者家裡有插滿高階顯卡的工作站,否則不建議輕易嘗試,因為跑起來可能會像幻燈片一樣慢。

03. 硬體殘酷擂台:你的電腦跑得動哪個版本?

「Leo,那我到底該下載哪個版本?」這是我最常被問到的問題。跑 AI 模型最看重的不是你的 CPU 有多快,而是你的 RAM(系統記憶體) 和 VRAM(顯示卡記憶體) 有多大。這裡我幫大家整理了一張超白話的電腦需求對照表:

| 模型版本 | 建議記憶體 (RAM/VRAM) | 適合對象與電腦類型 |

|---|---|---|

| Gemma 4: E2B | 大約 4GB – 8GB | 任何人都可以! 幾年前的舊筆電、MacBook Air M1 基礎版(8GB)都能輕鬆秒殺順跑。 |

| Gemma 4: E4B | 建議 8GB | 日常工作者。 近三年的電競筆電,或是 MacBook Pro M1/M2 (16GB) 可以跑得非常流暢。 |

| Gemma 4: 26B | 建議 16GB – 24GB | 進階玩家與工程師。 需要有獨立顯卡(如 RTX 3060/4060 12GB+)或是 Mac 統一記憶體 24GB 以上機型。 |

| Gemma 4: 31B | 至少 32GB (建議 64GB) | 有錢人與狂熱者。 需要高階工作站、Mac Studio,或是雙路顯卡的桌機才能享受它的完全體。 |

Leo 小提醒: Apple 的 Mac 系列(M1, M2, M3晶片)因為是採用「統一記憶體(Unified Memory)架構」,也就是系統記憶體跟顯示卡記憶體共用,所以在跑 AI 模型時有著天生的絕大優勢。一台 32GB 的 Mac,往往比一台 32GB RAM 但只有 8GB 顯卡的 Windows 桌機,能裝下更大的模型。

04. 新手救星:Ollama 一鍵安裝與模型下載教學

以前要裝本地 AI,你要先裝 Python、搞懂虛擬環境、下載一堆依賴套件,搞了半天滿螢幕紅字報錯。但現在,感謝 Ollama 這個開源軟體,它把跑 AI 變成像是裝 Line 一樣簡單。我們只要三個步驟:

第一步:去官網下載 Ollama

請打開瀏覽器搜尋「Ollama」,或是直接前往 `ollama.com`。首頁就有一個巨大的「Download」按鈕。無論你是 Mac 還是 Windows 用戶,直接下載並像安裝普通軟體一樣,一直按「下一步」安裝完成。安裝好後,你會在右下角(或右上角狀態列)看到一隻可愛的羊駝小圖示,這代表引擎已經在背景待命了。

第二步:打開你的終端機 (Terminal / 命命提示字元)

不要怕!我們只需要打一行字。Mac 用戶請按 `Cmd + 空白鍵` 搜尋「終端機」並打開;Windows 用戶請按 `Win 鍵` 搜尋「cmd」打開命令提示字元。

第三步:輸入指令,召喚 Gemma 4

根據你剛剛評估的電腦硬體,選擇你要下載的模型版本,將對應的指令複製貼上到終端機並按下 Enter:

ollama run gemma4:e2b# 召喚CP值最高的 26B 壓縮版

ollama run gemma4:26b

按下 Enter 後,Ollama 就會自動幫你從網路上下載模型檔(檔案有點大,可能需要幾分鐘到十幾分鐘不等)。只要出現 `Success`,並且游標變成 `>>>`,恭喜你!你可以直接在終端機裡面打字跟它聊天了。下次要用的時候,一樣打開終端機,輸入相同的指令,它就會直接秒開,不會再重新下載。

05. 真實開發心得:寫 App 測試的血淚與破解法

身為一個有實驗精神的開發者,我最近嘗試用 Gemma 4 (我用的是 26B 版本) 來幫我寫一個簡單的記帳 App 專案。不得不說,它的語法邏輯非常清晰,尤其是對現代的 React 或 Flutter 框架理解得很透徹,寫出來的 Code 幾乎沒有 Bug。

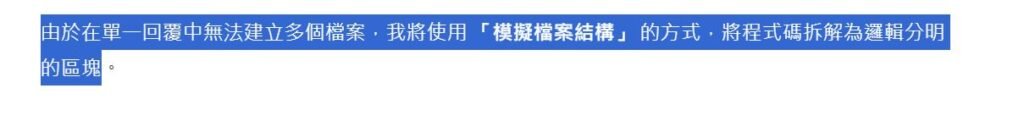

但是!我遇到了一個極度痛苦的問題:它每次只能給我一個 File(檔案)。

我們都知道,寫一個 App 不可能只有一個檔案,通常會有 `main.js`、`App.js`、`components/Header.js` 等等。當我下了指令:「請幫我寫一個完整的記帳 App 程式碼」時,它很熱情地跟我解釋了架構,然後劈哩啪啦寫了主程式的檔案……然後就停了。因為受限於單次生成的 **Context Window (上下文窗口 / Token 上限)**,它無法一次把十幾個檔案的幾千行程式碼吐出來給你。

我的破解心法:化整為零的 Prompt 技巧

為了繞過這個痛點,我改變了跟 Gemma 4 溝通的方式。既然它一次只能吐一個檔案,那我們就把它當成一個「聽口令動作」的專案執行者:

- Step 1:先要骨架,不要肉。

我會先問:「請列出這個記帳 App 需要的所有檔案結構與目錄樹,先不要寫任何程式碼。」 - Step 2:逐一擊破。

拿到目錄後,我再下指令:「現在,請只給我 `src/components/ExpenseList.js` 這個檔案的完整程式碼,不需要解釋。」 - Step 3:持續對話。

把檔案貼到我的編輯器後,再繼續說:「很好,接著給我下一個檔案 `src/App.js`。」

透過這種方式,Gemma 4 (26B) 的記憶力完全可以記住專案的脈絡,輸出的程式碼之間的變數也都有對接上。雖然比不上一鍵生成整個專案的付費服務,但考量到它是免費且完全在我的筆電上運作,這個能力已經讓我非常驚艷了!

06. 實用 FAQ 常見問題

Q1: 用 Ollama 跑 Gemma 4 需要網路連線嗎?

A: 只有在「第一次下載模型」的時候需要網路。只要下載成功出現 `Success` 後,你就算帶著筆電去深山露營、拔掉 Wi-Fi,它依然可以飛快地回答你的問題,這就是本地部署最大的魅力!

Q2: 如果我覺得 E2B 太笨,想換 26B 版本,需要重新安裝 Ollama 嗎?

A: 完全不用!Ollama 就像是個遊戲主機,模型就是遊戲片。你只需要在終端機輸入新的指令 `ollama run gemma4:26b`,它就會自動幫你下載新的遊戲片。你甚至可以在電腦裡同時保留多個版本,看心情切換使用。

07. 總結:擁抱開源,找回數據控制權

隨著生成式 AI 的發展,我們似乎已經習慣了把所有問題丟上雲端。但 Gemma 4 的出現,證明了本地端模型的實力已經足以應付我們日常工作中的八成需求。從靈巧的 E2B 到強悍的 31B,不管你的電腦設備在哪個層級,都能找到適合你的 AI 夥伴。

雖然在處理像「一次寫完一個完整 App」這種超大型任務時,它還是有單次輸出檔案的限制,但只要你掌握了對的溝通技巧,把大任務拆解成小步驟,它絕對能大幅提升你的工作效率。

- 害怕技術名詞? 從下載 Ollama 開始,只需要打一行字,一切自動搞定。

- 擔心硬體不夠? 從 E2B 版本開始嘗試,你會驚訝於現在的小模型有多聰明。

今天下班後,不妨花個十分鐘,跟著教學把 Gemma 4 裝進你的電腦裡。體驗一下不用付訂閱費、不用擔心資料外洩,擁有一個「完全屬於自己」的 AI 助理是什麼感覺吧!